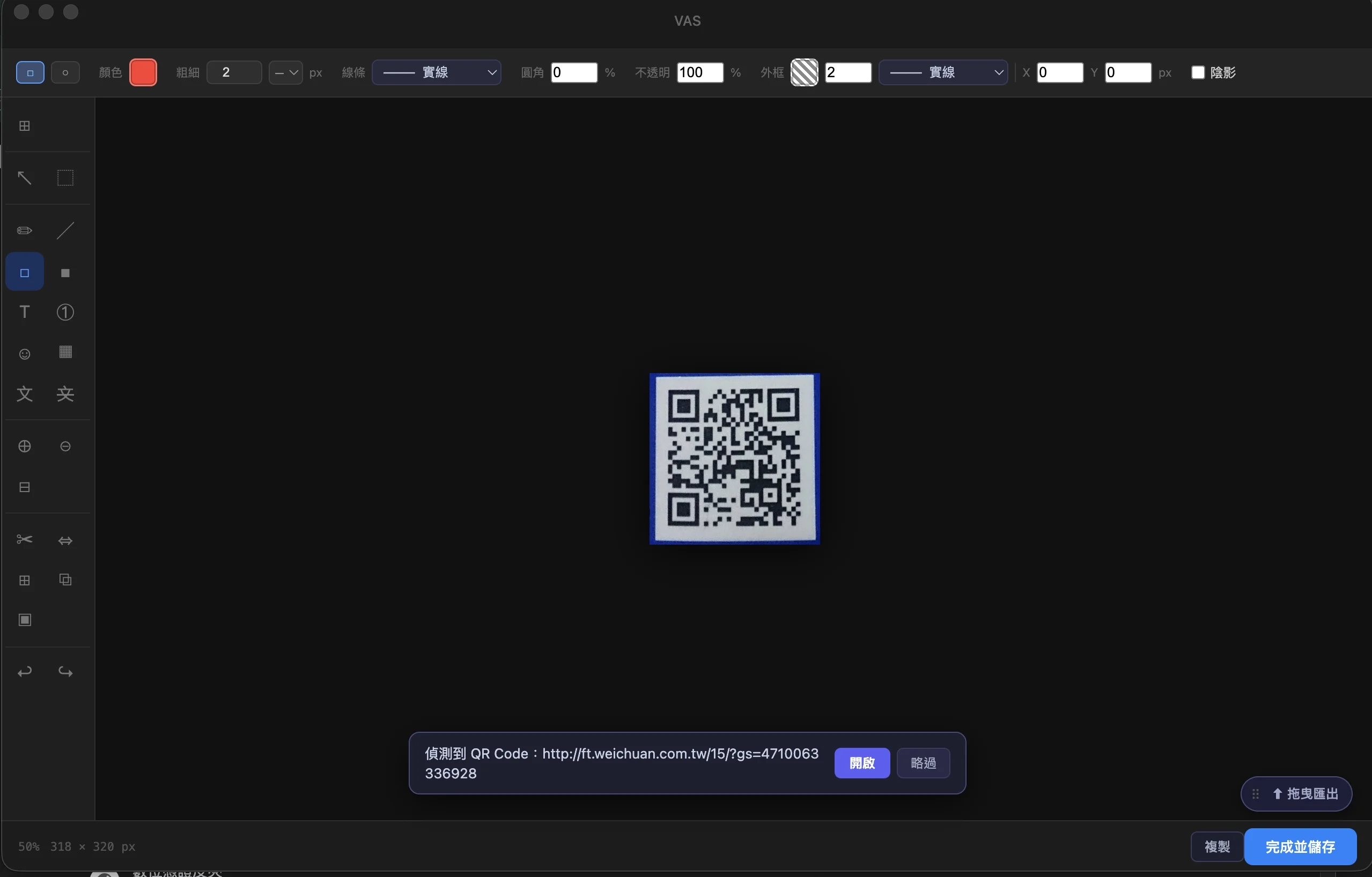

QR Code 掃到了,但它有多確定?

掃 QR Code 這件事,表面上只有「掃到」和「沒掃到」兩種結果。但 VAS 不這樣看——它看的是使用者意圖,然後根據意圖決定下一步要做什麼。

這也是一種人機協作:使用者用截圖的姿態說話,工具讀懂了。不需要語言,不需要按鈕,不需要選單——你怎麼框,就是你想要什麼。工具在讀的不是指令,是行為語言。

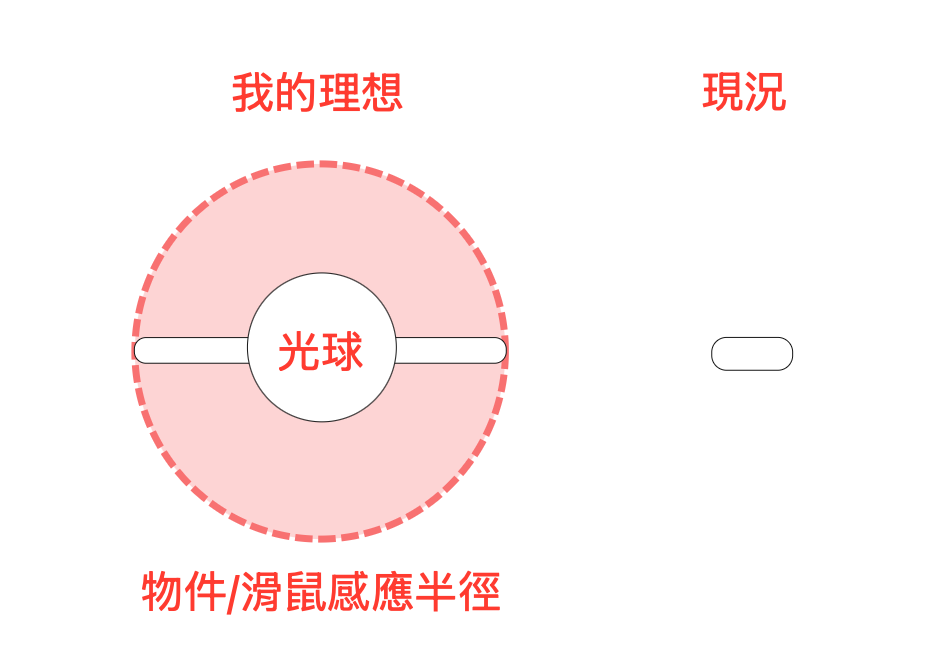

我們判斷當使用者想精準偵測 QR Code 時,自然會盡可能在選取框中完整而且僅有框 QR Code——這個動作本身就是意圖的宣告。QR Code 被框得佔選取區域越大,辨識越準,信心度越高,工具越能直接行動。使用者與工具之間,形成了一種不需要言語的默契。

工具不應該在自己不確定的時候假裝確定。確定你要 QR Code,就直接行動開啟連結;信心度模糊,就先問你是否要開啟連結;信心度太低,靜默開啟編輯器交給你判斷。每一個閾值背後,都是一個「我知道自己知道多少」的誠實設計。